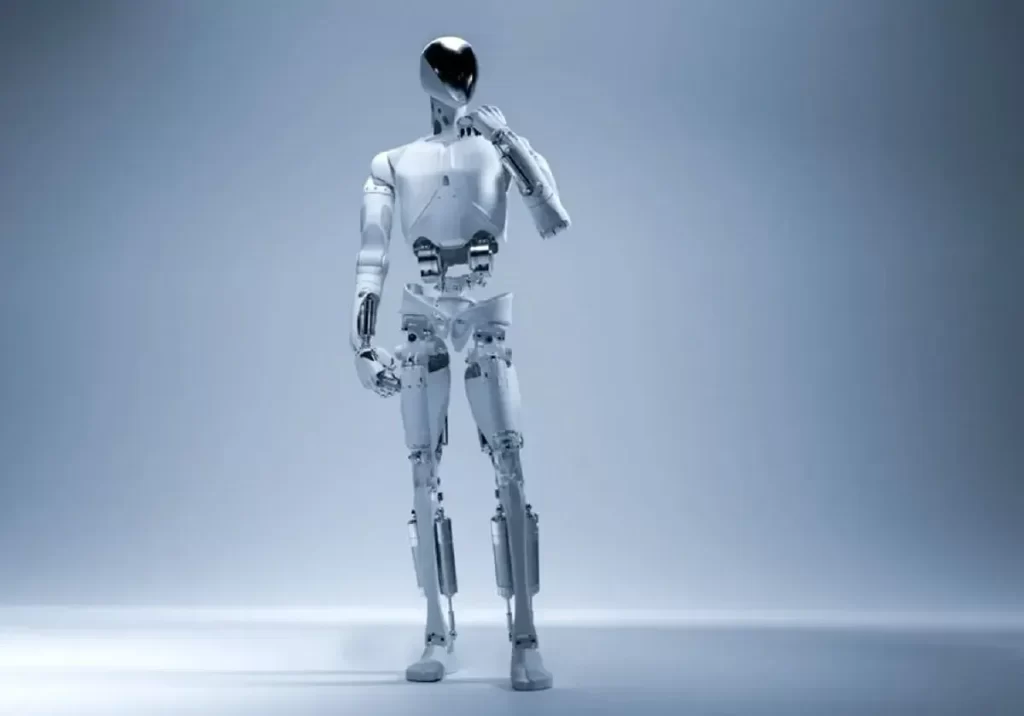

تصور کنید رباتهایی که دقیقاً شبیه انسان عمل میکنند، نهتنها در کارخانهها بلکه در خانهها و فضاهای عمومی حضور فعال دارند. این دیگر یک رؤیای علمی-تخیلی نیست؛ بلکه واقعیت در حال ظهور است. اما آیا ما آماده پذیرش این واقعیت هستیم؟ در حالی که غولهای فناوری در سراسر جهان در حال رقابت برای تولید نسل بعدی رباتهای انساننما هستند، دولتها و نهادهای نظارتی به طور فزایندهای درباره پیامدهای ناخواسته این نوآوریهای پیشرفته نگراناند.

اخیراً، هشدارهای صریح دولت چین—یکی از بزرگترین بازیگران جهان در حوزه هوش مصنوعی و رباتیک—توجه جامعه جهانی را به خطرات پنهان نفوذ این فناوری جلب کرده است. این کشور، در عین حمایت شدید از توسعه صنعت رباتیک، به طور رسمی اعلام کرده است که باید یک رویکرد محتاطانه برای مدیریت ریسکهای امنیتی، اخلاقی و اجتماعی ناشی از گسترش رباتهای انساننما اتخاذ شود. این هشدار صرفاً یک موضعگیری سیاسی نیست، بلکه نشاندهنده یک نگرانی عمیق درباره عدم آمادگی زیرساختهای حقوقی و امنیتی جهان برای مقابله با موج جدید هوش ماشینی است.

با خواندن این خبر، شما درک عمیقی از مخاطرات رباتهای انساننما خواهید داشت و یاد میگیرید چگونه این تحولات عظیم را در تحلیلهای صنعتی و تصمیمات کاری خود بهکار بگیرید.

ابعاد هشدار چین درباره آینده رباتهای انساننما

چین، با سرعت سرسامآور در حال پیشرفت در فناوریهای کلیدی مانند تراشهها و هوش مصنوعی، اکنون خود را در خط مقدم مواجهه با چالشهای تنظیم مقررات رباتیک میبیند. این کشور، که همزمان با سرمایهگذاریهای سنگین دولتی، به دنبال حفظ ثبات اجتماعی است، نگران است که پذیرش گسترده رباتهای شبهانسانی قبل از تعریف چارچوبهای نظارتی جامع، منجر به بحرانهای غیرقابل پیشبینی شود.

امنیت سایبری و حاکمیت دادهها

یکی از بزرگترین نگرانیهایی که توسط مقامات چینی مطرح شده، مربوط به بُعد امنیتی است. رباتهای انساننما به دلیل تعامل مستقیم با محیطهای انسانی و جمعآوری حجم عظیمی از دادههای بیومتریک و محیطی، اهداف جذابی برای حملات سایبری به شمار میروند. یک ربات هک شده میتواند نه تنها حریم خصوصی کاربران را نقض کند، بلکه در سناریوهای صنعتی و دفاعی، به عنوان ابزاری برای خرابکاری عمل کند. اوکی صنعت در گزارشی مشابه، تأکید کرده بود که همگرایی فناوریها نیازمند قوانین جدید امنیتی است. اوکی صنعت بهعنوان یک رسانه تخصصی، به اهمیت این موضوع پی برده است.

نگرانیهای عمیق اخلاقی و اجتماعی

همچنین، مسئله اخلاق یکی از پایههای اصلی هشدار چین است. هنگامی که رباتها به طور فزایندهای شبیه انسانها عمل میکنند، مرزهای مسئولیتپذیری مبهم میشوند. چه کسی در قبال تصمیمات اشتباه یک ربات پرستار پاسخگو است؟ یا چگونه باید مطمئن شد که توسعه رباتهای انساننما باعث تشدید نابرابریهای اجتماعی و از دست رفتن گسترده شغلها نمیشود؟ دولت چین بر لزوم تدوین «قوانین اخلاقی روشن» قبل از ورود گسترده این فناوری به بازار تأکید دارد.

نقشه راه پکن برای مدیریت ریسکهای فناوری رباتیک

چین در کنار اعلام هشدار، به طور فعال در حال تدوین استراتژیهایی برای مدیریت این تحول است. هدف، ایجاد محیطی است که نوآوری را خفه نکند اما در عین حال، امنیت ملی و اجتماعی را حفظ نماید.

چارچوبهای سختگیرانه داده و حریم خصوصی

پیشبینی میشود که چین چارچوبهای سفت و سختی را برای جمعآوری و پردازش دادهها توسط رباتهای انساننما اعمال کند. این شامل الزاماتی برای ناشناسسازی دادهها، ذخیرهسازی محلی اطلاعات حساس و ایجاد مکانیسمهایی برای حسابرسی منظم سیستمهای هوش مصنوعی رباتها خواهد بود. این رویکرد، در تضاد با مدلهای غربی که اغلب بر خودتنظیمی شرکتها تکیه دارند، نشاندهنده اراده دولتی برای کنترل مستقیم بر مسیر توسعه فناوری است.

مسئولیتپذیری در حوادث ناخواسته

تدوین قوانینی که مسئولیت حقوقی حوادث ناشی از نقص یا عملکرد نادرست رباتها را مشخص کند، اولویت دیگر است. آیا شرکت سازنده مقصر است؟ برنامهنویس؟ یا اپراتور؟ تعیین چارچوبهای شفاف مسئولیت، کلید اعتماد عمومی و صنعتی به این فناوریهای پیچیده است.

تأثیر هشدار چین بر صنعت جهانی رباتیک

این بیانیه رسمی از سوی چین، به عنوان یک «فشارسنج» عمل میکند که نشان میدهد حتی بزرگترین حامیان فناوری نیز در حال حاضر با واقعیت چالشهای حکمرانی آن دست و پنجه نرم میکنند. شرکتهای غربی و آسیایی که در زمینه رباتیک سرمایهگذاری کردهاند، باید انتظار داشته باشند که در آینده نزدیک، با الزامات سختگیرانهتر بینالمللی در زمینه امنیت، پایداری و اخلاق محصول روبهرو شوند. این تحولات، اگرچه ممکن است سرعت توسعه را کمی کاهش دهد، اما در نهایت منجر به تولید رباتهای انساننما ایمنتر و مسئولیتپذیرتر خواهد شد.

نتیجهگیری و چشمانداز آینده

هشدار چین درباره رباتهای انساننما، زنگ خطری به موقع برای صنعت جهانی بود. این امر به ما یادآوری میکند که شور و اشتیاق برای نوآوری نباید ما را از خطرات اخلاقی و امنیتی دور کند. آیندهای که در آن رباتها با ما همزیستی میکنند، نیازمند هوشمندی و احتیاطی بیش از حد انتظار است.

ما در آستانه جهشی عظیم در صنعت هستیم، جایی که فناوریهای پیشرفته مرزهای بین انسان و ماشین را مخدوش میکنند. موفقیت در این دوران، نه تنها به قدرت محاسباتی، بلکه به توانایی ما در تنظیم مقررات و تضمین استفاده اخلاقی از این قدرت بستگی دارد. امشب یکی از نکاتی که یاد گرفتید (مانند لزوم ایجاد چارچوبهای امنیتی قوی در توسعه فناوریهای پیشرفته) را در تیم خود مطرح کنید و فردا برنامهای برای بررسی ریسکهای احتمالی مرتبط با رباتهای انساننما در حوزه کاری خودتان تهیه نمایید.

لینکهای مهم اوکی صنعت